Replicate

API de inferencia multi-modelo para ML open source con pago por segundo y deploy en un comando.

Descripción

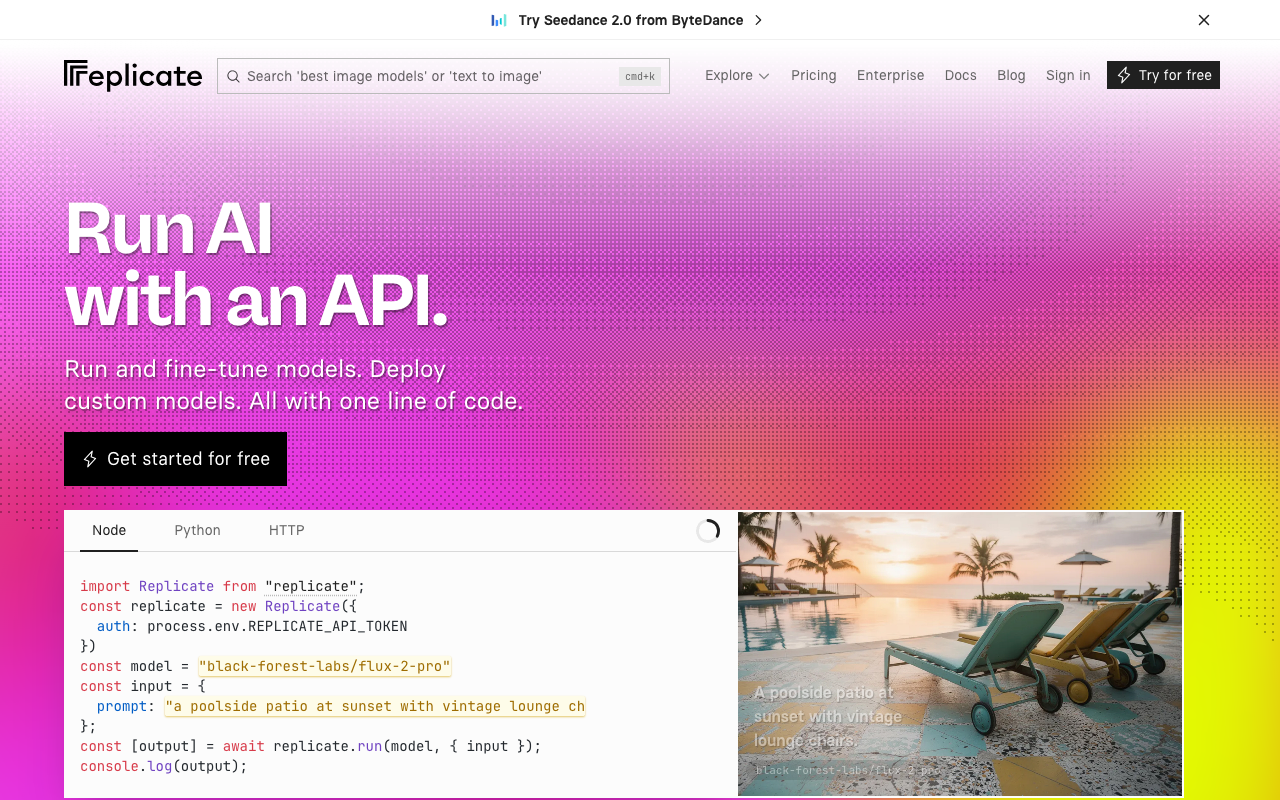

Replicate es la plataforma de inferencia que popularizó la idea de ejecutar modelos open source de ML como si fueran endpoints HTTP. En 2026 ofrece miles de modelos públicos (FLUX, SDXL, Whisper, LLaMA, Stable Video, Claude, GPT vía proxy, TTS, embeddings, ControlNets) con un SDK en Python y JavaScript, facturando por segundo de GPU (desde $0.000025/s en CPU pequeño hasta $0.0112/s en 8x A100) o por salida en modelos curados (FLUX Pro $0.04/img, Claude 3.7 Sonnet $3/M tokens entrada). Permite subir modelos propios empaquetados con Cog, hacer fine-tuning de LoRAs y exponerlos como endpoints privados. No hay suscripción: pagas por uso con algo de crédito inicial tras registrarse y opción enterprise para volúmenes altos.

Vista previa

Evaluación Detallada

Ventajas principales

Catálogo enorme de modelos open source

Miles de modelos comunitarios y oficiales listos para ejecutarse con una sola llamada HTTP, desde imagen a audio, video y texto.

Cog: empaqueta tu propio modelo

La herramienta Cog permite convertir cualquier modelo Python en una imagen reproducible y publicarla como endpoint en minutos.

Pricing granular por segundo

Pagas exactamente el tiempo de GPU que tu modelo consume, con hardware configurable desde CPU pequeño hasta 8x A100.

Fine-tuning accesible

Lanzar fine-tunes (LoRAs de FLUX, SDXL, etc.) es cuestión de un API call y los resultados se despliegan automáticamente.

Excelente DX en JS y Python

Los SDKs oficiales son minimalistas y hacen trivial integrar streaming, webhooks y cancelación de trabajos.

Limitaciones a considerar

Cold starts y latencia variable

Modelos menos populares pueden tardar decenas de segundos en arrancar la primera vez, algo mal tolerado por apps user-facing.

Facturación fácil de subestimar

Sumar segundos en 8x A100 para video escala rápido, y sin buenos límites puedes ver facturas inesperadas.

Velocidad de inferencia inferior a Fal

Para modelos de difusión populares, Fal suele ser varias veces más rápido por el runtime optimizado, lo que penaliza a Replicate en producción.

Free tier simbólico

Los créditos iniciales son suficientes para probar, pero no para prototipar seriamente sin introducir tarjeta.

Característica Destacada

La combinación de catálogo masivo de modelos open source + Cog para empaquetar los tuyos es única: Replicate sigue siendo en 2026 la forma más sencilla de pasar de un repo de investigación a un endpoint HTTP en producción.

Comparación con Alternativas

Frente a Fal es más flexible y con catálogo más abierto pero más lento en difusión; frente a Hugging Face Inference Endpoints tiene mejor DX y cobro por segundo más granular; frente a Modal o Runpod renuncia a control bajo de GPU a cambio de simplicidad brutal.

Usuario Ideal

Desarrolladores e investigadores que quieren experimentar con modelos open source de ML, empaquetar los suyos con Cog y exponerlos a producción sin montar infraestructura propia. También encaja para productos que necesitan acceso puntual a decenas de modelos distintos.

Curva de Aprendizaje

Ejecutar un modelo es tan simple como llamar a 'replicate.run'. La curva aparece al empaquetar con Cog, optimizar cold starts, hacer fine-tuning serio o contener costes en modelos pesados.

Ideal Para

- Desarrolladores que quieren probar modelos open source sin montar GPUs

- Productos que integran generación de imagen con FLUX o SDXL

- Pipelines ASR+TTS con Whisper y modelos de voz open source

- Equipos que empaquetan modelos propios con Cog y los exponen como API

- Fine-tuning rápido de LoRAs y despliegue inmediato como endpoint

No Ideal Para

- Casos con requisitos duros de latencia sub-segundo en difusión (Fal va por delante)

- Proyectos sin presupuesto donde un free tier amplio es imprescindible

- Workloads muy sensibles a control fino del hardware